単回帰分析(1)大雑把な説明

はじめに

いわゆる「回帰分析」「回帰モデル」と呼ばれる統計方法のうち、最もシンプルな形式で多くの人に知られていると思われる「単回帰分析(Simple regression)」の話をしていこうと思う。

単回帰分析は、平面上のデータ点が散らばっているところへちょうどいい具合に直線をひくことになるので、直感的にとてもわかりやすい。しかしながら、その裏にはきちんとした数学的根拠があるのである。

今回はまず、どんなことをやっているのか、大雑把な説明をしていきたいと思う。

何をやっているのか

単回帰分析とは、端的に言うと、ある変数の値を他の変数

の値を使って説明するような数式を立てることである(ただし、「

にある定数を掛ける」と「それにある定数を足す」という条件を課す。

の側にこのような制約を置くことはとても多いが、

を使うなど、例外ももちろんある)。説明される側の変数

のことは目的変数・応答変数・反応変数・従属変数などなど、分野によっても人によっても色々な言い方がされる。ここでは目的変数と呼ぶことにする。

を説明するための変数

は説明変数と呼ばれる。

で

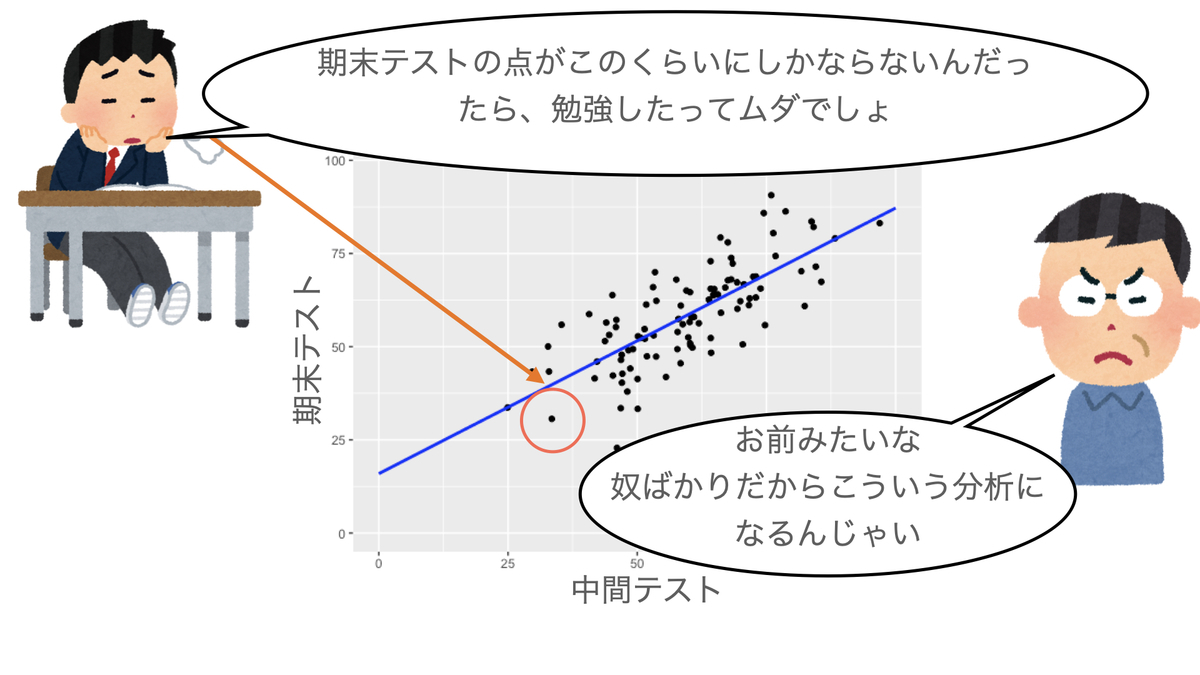

を説明するとはどういうことか。次のようなデータがあるとする。

ここでを中間テストの得点、

を期末テストの得点とすると、中間テストの成績がよかった(悪かった)人は期末テストでもよい(悪い)成績を収めたように見える。何だか、中間テストの得点で期末テストの得点を説明できそうな気がするのではないだろうか。

そのためには、期末テストの得点がどんな値でも、どうにかして中間テストの得点

で説明できるような数式を作らないといけない。「

にある定数を掛ける」と「それにある定数を足す」という縛りを考えると

この状態では、

この赤い直線は一次関数だが、データにしっくりきてはいないように見える。

どちらかと言えば、この緑の直線のほうがしっくりきていると言えるだろう。しかし、実際のどのデータ点からもちょっとだけズレてしまっている。直線で表現する以上、ズレを完全になくすことはできないので、せめてズレが最小になるような直線を選ぶことにする。すると、

なお数式の

以上が、単回帰分析でやっていることの大まかな説明である。実際に計算すると次のようになる。

赤丸で囲っているところが、一番しっくりくる直線を選んだ結果決まった

選ばれた直線を元のデータ点に重ねると、次のようになった。

この直線によって、